Toma una foto de tu comida y la inteligencia artificial te dirá instantáneamente el recuento de calorías, el contenido de grasa y el valor nutricional: no más diarios de alimentos ni conjeturas. Este escenario futurista ahora está mucho más cerca de la realidad, gracias a un sistema de IA desarrollado por investigadores de la Escuela de Ingeniería Tandon de NYU que promete una nueva herramienta para los millones de personas que desean controlar su peso, diabetes y otras condiciones de salud relacionadas con la dieta.

La tecnología, detallada en un artículo presentado en la VI Conferencia Internacional IEEE sobre Computación Móvil e Informática Sustentable, utiliza algoritmos avanzados de aprendizaje profundo para reconocer alimentos en imágenes y calcular su contenido nutricional, incluidas calorías, proteínas, carbohidratos y grasas. Durante más de una década, el Grupo de Investigación sobre Incendios de la Universidad de Nueva York (NYU), que incluye al autor principal del artículo, Prabodh Panindre, y al coautor, Sunil Kumar, ha estudiado la salud crítica de los bomberos y los desafíos operativos. Diversos estudios de investigación muestran que entre el 73% y el 88% de los bomberos profesionales y entre el 76% y el 87% de los voluntarios tienen sobrepeso u obesidad, lo que implica mayores riesgos cardiovasculares y de salud que amenazan su preparación operativa. Estos hallazgos motivaron directamente el desarrollo de su sistema de seguimiento de alimentos basado en IA.

“Los métodos tradicionales de seguimiento de la ingesta de alimentos se basan en gran medida en la autoevaluación, que es notoriamente poco fiable”, afirmó Panindre, profesor asociado de investigación del Departamento de Ingeniería Mecánica de la Escuela de Ingeniería Tandon de la Universidad de Nueva York. “Nuestro sistema elimina el error humano de la ecuación”.

A pesar de la aparente simplicidad del concepto, el desarrollo de una IA fiable para el reconocimiento de alimentos ha desconcertado a los investigadores durante años. Los intentos anteriores se enfrentaron a tres desafíos fundamentales que el equipo de Tandon de la Universidad de Nueva York parece haber superado.

“La enorme diversidad visual de la comida es asombrosa”, afirmó Kumar, profesor de Ingeniería Mecánica en la Universidad de Nueva York (NYU) Abu Dabi y profesor de la Red Global de Ingeniería Mecánica en la Universidad de Nueva York Tandon. “A diferencia de los objetos manufacturados con apariencias estandarizadas, un mismo plato puede verse radicalmente diferente según quién lo prepare. Una hamburguesa de un restaurante se parece poco a otra de otro, y las versiones caseras añaden un nivel de complejidad adicional”.

Los sistemas anteriores también presentaban fallas al estimar el tamaño de las porciones, un factor crucial en los cálculos nutricionales. El avance del equipo de la Universidad de Nueva York reside en su función de cálculo volumétrico, que utiliza procesamiento avanzado de imágenes para medir la superficie exacta que ocupa cada alimento en un plato.

El sistema correlaciona el área ocupada por cada alimento con la densidad y los datos de macronutrientes para convertir imágenes 2D en evaluaciones nutricionales. Esta integración de los cálculos volumétricos con el modelo de IA permite un análisis preciso sin intervención manual, solucionando un desafío recurrente en el seguimiento alimentario automatizado.

El tercer obstáculo importante ha sido la eficiencia computacional. Los modelos anteriores requerían demasiada potencia de procesamiento para ser prácticos en tiempo real, lo que a menudo requería procesamiento en la nube, lo que generaba retrasos y problemas de privacidad.

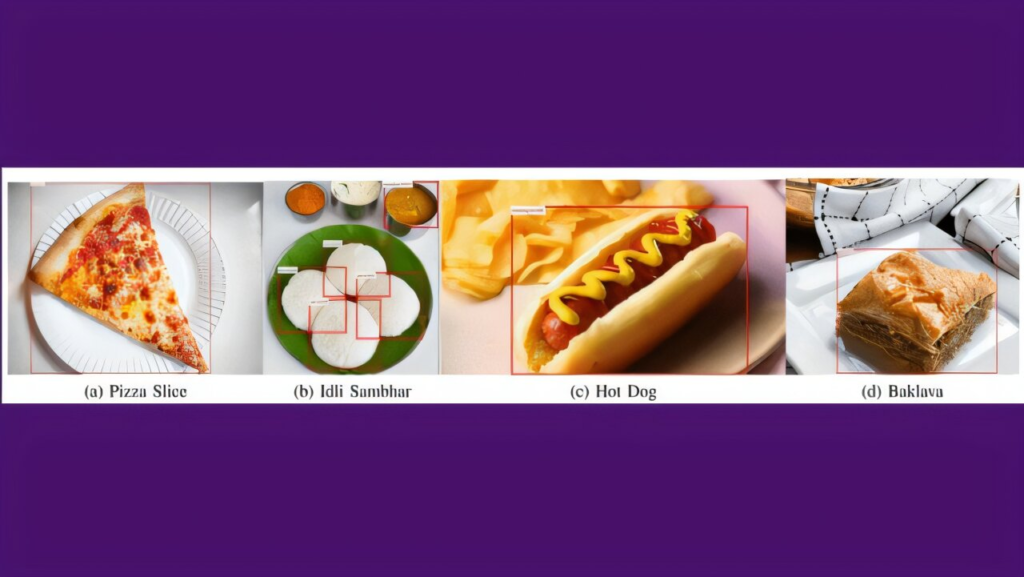

Los investigadores utilizaron una potente tecnología de reconocimiento de imágenes llamada YOLOv8 con ONNX Runtime (una herramienta que ayuda a que los programas de IA funcionen de manera más eficiente) para crear un programa de identificación de alimentos que se ejecuta en un sitio web en lugar de como una aplicación descargable, lo que permite a las personas simplemente visitarlo usando el navegador web de su teléfono para analizar las comidas y realizar un seguimiento de su dieta. Al probar una rebanada de pizza, el sistema calculó 317 calorías, 10 gramos de proteína, 40 gramos de carbohidratos y 13 gramos de grasa, valores nutricionales que coincidieron estrechamente con los estándares de referencia. Obtuvo un rendimiento similar al analizar platos más complejos como el idli sambhar, una especialidad del sur de la India que consiste en pasteles de arroz al vapor con guiso de lentejas, para el cual calculó 221 calorías, 7 gramos de proteína, 46 gramos de carbohidratos y tan solo 1 gramo de grasa.

“Uno de nuestros objetivos era garantizar que el sistema funcionara con diversas cocinas y presentaciones de alimentos”, dijo Panindre. “Queríamos que fuera tan preciso con un perrito caliente (280 calorías según nuestro sistema) como con el baklava, un pastel de Oriente Medio que nuestro sistema identifica con 310 calorías y 18 gramos de grasa”.

Los investigadores resolvieron los desafíos de los datos combinando categorías de alimentos similares, eliminando los tipos de alimentos con pocos ejemplos y dando mayor énfasis a ciertos alimentos durante el entrenamiento. Estas técnicas ayudaron a refinar su conjunto de datos de entrenamiento, pasando de innumerables imágenes iniciales a un conjunto más equilibrado de 95.000 instancias en 214 categorías de alimentos.

Las métricas de rendimiento técnico son impresionantes: el sistema alcanzó una puntuación media de Precisión Promedio (mAP) de 0,7941 con un umbral de Intersección sobre Unión (IoU) de 0,5. Para los no especialistas, esto significa que la IA puede localizar e identificar alimentos con precisión aproximadamente el 80% del tiempo, incluso cuando se superponen o están parcialmente ocultos.

El sistema se ha implementado como una aplicación web compatible con dispositivos móviles, lo que lo hace potencialmente accesible para cualquier persona con un teléfono inteligente. Los investigadores describen su sistema actual como una “prueba de concepto” que podría perfeccionarse y ampliarse muy pronto para aplicaciones más amplias en el ámbito de la atención médica.

Además de Panindre y Kumar, los autores del artículo son Praneeth Kumar Thummalapalli y Tanmay Mandal, ambos estudiantes de maestría en el Departamento de Ciencias de la Computación e Ingeniería de NYU Tandon.

Fuente: Tech Xplore.