Investigadores han logrado un nuevo récord de fidelidad de cúbits en sistemas informáticos cuánticos superconductores, superando una barrera clave en la computación cuántica. En un estudio publicado el 27 de febrero en la revista Nature Communications, científicos de IBM, la Universidad RWTH Aachen en Alemania y la empresa emergente Quantum Elements, con sede en Los Ángeles, abordaron la corrección y supresión de errores cuánticos, que es el mayor obstáculo para construir máquinas más potentes que las supercomputadoras más rápidas.

Las computadoras cuánticas superconductoras utilizan bits cuánticos (qubits), el equivalente cuántico de un bit informático, para realizar cálculos. Los sistemas que utilizaron los investigadores —los procesadores Kyiv y Marrakesh de IBM, de 127 qubits— emplean una combinación de “qubits físicos” y “qubits lógicos”, grupos de qubits físicos entrelazados que almacenan la misma información en diferentes lugares, en caso de que un qubit físico que almacena esa información falle durante un cálculo.

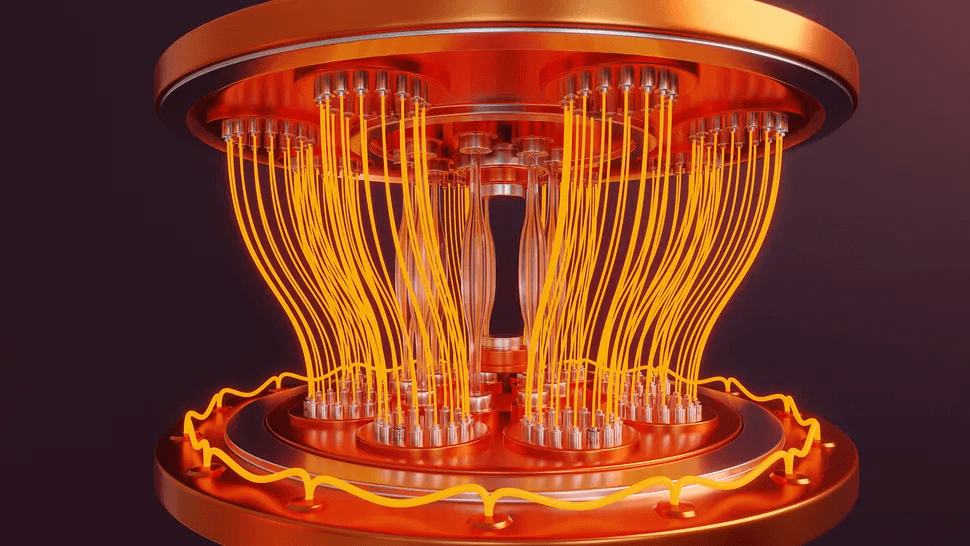

Los cúbits físicos están integrados en la capa de hardware de una computadora cuántica como un circuito complejo y geométricamente preciso hecho de metal superconductor. Cuando se enfrían a temperaturas cercanas al cero absoluto, estos metales pierden toda resistencia eléctrica, lo que permite que la información cuántica fluya sin pérdida de energía.

Pero estos cúbits son susceptibles a la más mínima perturbación, incluyendo vibraciones, ruido ambiental y otros factores ambientales, lo que los hace frágiles por naturaleza. Para compensar esta fragilidad, los científicos agrupan varios cúbits físicos para formar un cúbit lógico.

Cuando se realizan cálculos entre cúbits lógicos, los cúbits físicos actúan como bits de paridad que eliminan errores. Sin embargo, el problema inherente a esta configuración, según afirman los científicos en el nuevo estudio, es que es vulnerable a los “errores lógicos”.

Los errores lógicos ocurren cuando varios cúbits físicos dentro de un cúbit lógico fallan debido al ruido. Básicamente, cuando un cúbit físico falla, los demás actúan como un mecanismo de seguridad contra su señal errónea. Pero cuando fallan varios cúbits, el sistema interpreta el error que producen como la señal correcta, y el cálculo se invalida.

Suprimir los errores antes de que ocurran

Los sistemas IBM de 127 cúbits que utilizaron los investigadores son propensos a un tipo específico de ruido llamado “diafonía ZZ”, que se genera por la disposición particular de sus cúbits físicos. El equipo de Quantum Elements desarrolló un enfoque híbrido para abordar este tipo específico de ruido. Este enfoque consiste en suprimir los errores de diafonía antes de que se produzcan, reduciendo así la cantidad total de errores lógicos indetectables. Combinaron esta técnica con herramientas de corrección de errores ya existentes para crear un novedoso protocolo híbrido.

Como resultado, los investigadores lograron realizar los cálculos cuánticos de mayor fidelidad —aquellos con la menor cantidad de ruido— en cúbits superconductores durante el período de tiempo más prolongado registrado hasta la fecha. Según el estudio, los científicos habían logrado previamente una fidelidad de codificación máxima del 79,5% en un intento y del 93,7% en otro, que posteriormente disminuyó a aproximadamente el 30% después de unos 27 microsegundos.

La métrica de fidelidad máxima indica la mayor precisión alcanzada dentro del sistema cuántico, la cual se produce inmediatamente después de la formación del cúbit lógico. Cuanto más tiempo pueda un ordenador cuántico mantener una fidelidad máxima o cercana a la máxima, mayor será su capacidad para ejecutar algoritmos cuánticos.

El equipo pulverizó esos récords anteriores utilizando una nueva técnica llamada desacoplamiento dinámico de normalización (NDD). Lograron una fidelidad de codificación máxima del 98,05 %, que se mantuvo en un 84,87% después de 55 microsegundos.

El desacoplamiento dinámico convencional, una técnica estándar de corrección de errores, consiste en utilizar pulsos de microondas para forzar a los cúbits físicos a alternar su estado. Esto regula los cúbits y, por lo general, minimiza el ruido de fondo, pero lo hace de uno en uno.

Sin embargo, existe un problema al escalar esta técnica: cuantos más cúbits físicos haya en un sistema, más pulsos de microondas se necesitan para suprimir el ruido. A la larga, esto genera ruido adicional y añade aún más errores al sistema, lo que anula su propósito, explicaron los autores del estudio.

Sin embargo, los científicos aplicaron este paradigma a la capa lógica de cúbits, en lugar de ejecutarlo exclusivamente en la capa de hardware. Para ello, tuvieron que inventar un método para ajustar sus pulsos, utilizando un “normalizador” matemático basado en el código cuántico que se ejecutaba en la propia máquina. Esto permitió que pulsara con un ritmo que se correlacionaba con el código de la máquina.

El resultado, el desacoplamiento dinámico del normalizador, produjo los cálculos de mayor fidelidad realizados hasta la fecha en una computadora cuántica superconductora. Cuanto más tiempo se pueda mantener este nivel de alta fidelidad, más útiles serán las computadoras cuánticas.

El número de puertas cuánticas —u operaciones cuánticas individuales— que un sistema cuántico puede ejecutar depende de cuánto tiempo pueda mantener la fidelidad cuántica. Normalmente, una sola puerta tarda entre 10 y 12 nanosegundos en ejecutarse. Esto significa que podrían producirse aproximadamente entre 4500 y 5500 operaciones consecutivas en los 55 microsegundos antes de que los datos se degraden, como se demuestra en este estudio.

El objetivo final de la computación cuántica es crear un dispositivo capaz de funcionar con alta fidelidad durante el tiempo suficiente para realizar operaciones realmente útiles, como ejecutar el algoritmo de Shor para descifrar códigos. Se estima que funciones avanzadas como estas podrían tardar algún día semanas o meses en completarse correctamente en un sistema cuántico capaz, lo cual no está nada mal si se tiene en cuenta que a una computadora clásica le podría llevar cientos de billones de años lograr el mismo resultado. Los 55 microsegundos de actividad de alta fidelidad, un récord histórico, parecen estar muy lejos de lograr una utilidad práctica, pero representan un salto significativo con respecto a los esfuerzos anteriores.

Fuente: Live Science.