Las imágenes y los vídeos generados por IA suponen una amenaza para los procesos democráticos y socavan la confianza en la sociedad. Investigadores de la ETH Zúrich han desarrollado una tecnología de chips que permite verificar la autenticidad de los datos de los sensores, incluidas imágenes y vídeos. Su estudio se ha publicado en la revista Nature Electronics.

La inteligencia artificial (IA) facilita enormemente la manipulación de fotos, vídeos y grabaciones de audio. Ya sean declaraciones falsas atribuidas a políticos o imágenes engañosas de zonas de crisis, las redes sociales y las plataformas en línea están inundadas de los llamados deepfakes. Las consecuencias para la sociedad y la democracia son graves: cada vez más personas son engañadas por estas falsificaciones o empiezan a desconfiar incluso de fuentes creíbles.

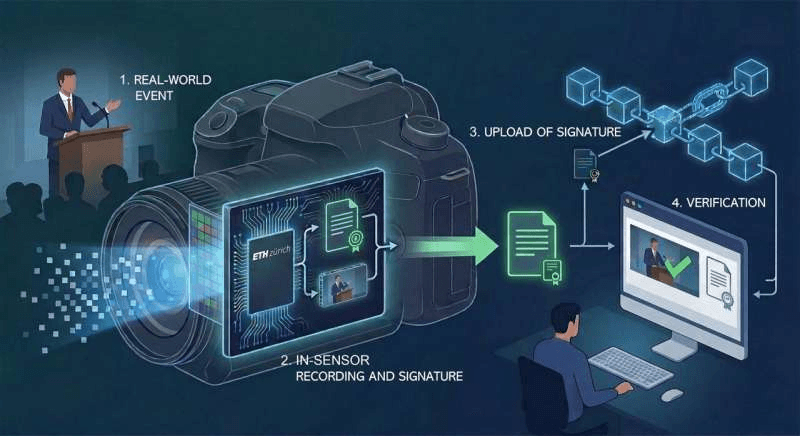

Investigadores de la ETH Zúrich han desarrollado una nueva tecnología de sensores que aborda directamente este problema. El concepto consiste en firmar criptográficamente imágenes, vídeos o señales de audio dentro de un chip sensor en el momento exacto de su captura. Esta firma permite verificar que los datos provienen realmente de una cámara o dispositivo de grabación, indica cuándo se capturaron y garantiza que no han sido manipulados.

“Si los datos se firman en el momento de su captura, cualquier manipulación posterior deja rastro”, explica Fernando Cardes, codesarrollador de la tecnología. “Para manipular los datos, habría que atacar físicamente el chip, lo que requeriría un enorme esfuerzo tecnológico, por lo que la generación masiva de contenido manipulado para las redes sociales sería prácticamente imposible”. Cardes es investigador asociado en la Cátedra Andreas Hierlemann de Ingeniería de Biosistemas, perteneciente al Departamento de Ciencias e Ingeniería de Biosistemas (BSSE) de Basilea.

Verificación sencilla gracias a un registro público

Las firmas generadas por el sensor podrían ser almacenadas por los fabricantes de cámaras en un registro público e inmutable (por ejemplo, una cadena de bloques). Este enfoque permitiría a cualquier persona verificar la autenticidad de los datos en cuestión en cualquier momento, comparando la firma del chip almacenada en el registro con los datos originales y confirmando su origen.

“Por lo tanto, resulta prácticamente irrelevante si una persona o la tecnología involucrada en el procesamiento y la transmisión de datos es confiable”, explica Felix Franke, codesarrollador del chip en la ETH Zúrich y actualmente profesor en la Universidad de Basilea. “La confianza en el contenido digital se está erosionando. Queríamos crear una tecnología que permitiera a las personas verificar la autenticidad de la información”.

En principio, la tecnología puede integrarse en cualquier tipo de sensor o cámara. En el futuro, las plataformas de redes sociales podrían verificar automáticamente la autenticidad del contenido en cuanto se publique. En caso contrario, periodistas, investigadores o autoridades públicas podrían autenticar el contenido por sí mismos mediante herramientas sencillas.

La amenaza de los deepfakes se identificó en una etapa temprana

La idea de los chips sensores surgió como un proyecto paralelo en el Laboratorio de Bioingeniería de la ETH Zúrich. Mucho antes de que sistemas de IA como ChatGPT se convirtieran en tema de debate público, el laboratorio ya trabajaba en sensores de alta sensibilidad para medir señales eléctricas de células vivas. El equipo interdisciplinario también contaba con la experiencia necesaria para incorporar funciones criptográficas adicionales directamente en los chips sensores.

“El peligro que suponían los deepfakes era previsible”, recuerda Franke. Por lo tanto, ya en 2017 se ideó un plan para desarrollar un sensor cuyos datos no pudieran manipularse sin ser detectados.

El chip es un prototipo funcional que demuestra su viabilidad técnica. Aún se requieren pasos adicionales antes de su comercialización. No obstante, los investigadores confían en que, con las tecnologías y los procesos actuales, el chip pueda convertirse en un producto funcional y listo para el mercado. Por lo tanto, han presentado una solicitud de patente.

“Actualmente estamos estudiando cómo reducir los costes para los fabricantes de cámaras y sensores en caso de que deseen incorporar la nueva tecnología en sus chips”, informa Cardes.

Fuente: Tech Xplore.